モデル接続 (MCP/Agent)¶

この記事では、FIRERPA を大規模言語モデルと連携させる方法(MCP またはコマンドベース)について説明します。FIRERPA は、MCP サーバーサイドプロトコルと OpenAI ネイティブの tool-call 機能を下位層で実装しており、独自の MCP プラグインを作成して標準の 65000 ポートでサービスを提供したり、Agent クラスを継承して全自動の tools 呼び出しを実現したりできます。

組み込み Agent コマンド¶

組み込みの agent コマンドを使用すると、大規模言語モデルを通じて完全に口語的なタスクを迅速に完了できます。OpenAI API + toolcall と互換性のある任意のサービスプロバイダーまたは自己ホスト型サービスをサポートしています。組み込みの crontab と組み合わせることで、口語的なタスクの定期実行を実現できます。

ヒント

注目

必要な情報を準備したら、リモートデスクトップのターミナルで以下のコマンドを入力することで、AI にデバイスを自動操作させることができます。

agent --api https://generativelanguage.googleapis.com/v1beta/openai/chat/completions --key YOUR_API_KEY --model gemini-2.5-flash --prompt "設定アプリ(パッケージ名 com.android.settings)を開き、ネットワーク設定を見つけて、機内モードをオンにしてください"

タスクのプロンプトが長すぎる場合は、ファイルでモデルのプロンプトを提供することもできます。

agent --api https://generativelanguage.googleapis.com/v1beta/openai/chat/completions --key YOUR_API_KEY --model gemini-2.5-flash --prompt /path/to/prompt.txt

Claude & Cursor 接続(MCP)¶

このセクションでは、FIRERPA の MCP 機能を大規模言語モデルクライアントに接続する方法について説明します。ここでは Claude と Cursor を例として示しますが、MCP プロトコルをサポートする他の任意の場所でも使用できます。

注釈

注目

公式拡張機能のインストール¶

私たちは公式の MCP サービスを提供しており、extensions/firerpa.py からこの拡張モジュールをダウンロードできます。その作成方法を参考にして、自分でプラグイン機能を作成または拡張することもできます。拡張プラグインスクリプトをダウンロードした後、リモートデスクトップまたは手動の push を使用して、デバイスの /data/usr/modules/extension ディレクトリにアップロードし、デバイスを再起動するか、FIRERPA サービスを再起動してください。

注目

公式拡張機能の使用¶

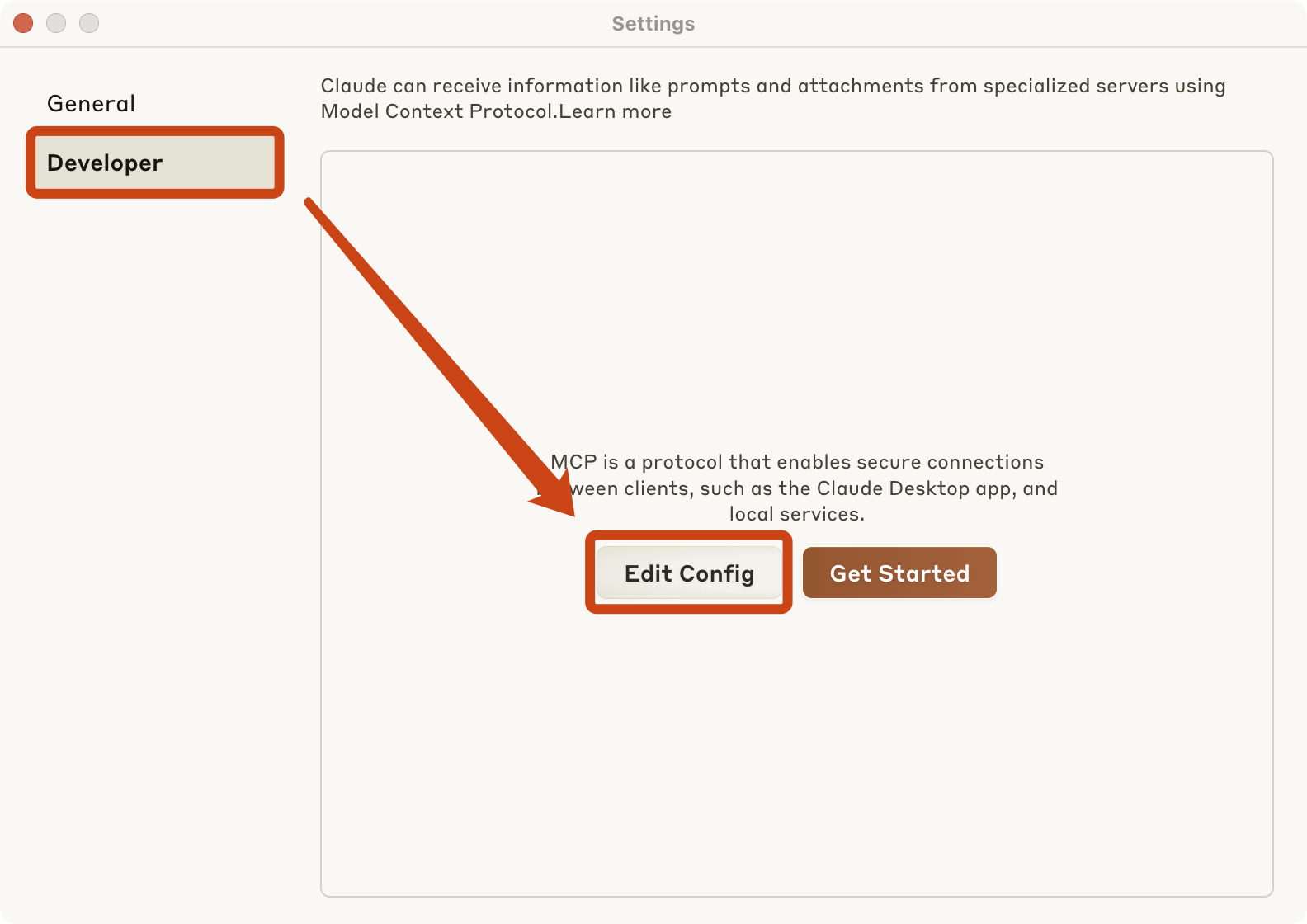

Claude の場合、まず Claude の設定ページを見つけ、下図の手順に従って操作する必要があります。そして、プロンプトに従って Claude の claude_desktop_config.json 設定ファイルを編集し、以下の MCP json サービス設定を書き込みます。

{"mcpServers": {"firerpa": {"command": "npx", "args": ["-y", "supergateway", "--streamableHttp", "http://192.168.0.2:65000/firerpa/mcp/"]}}}

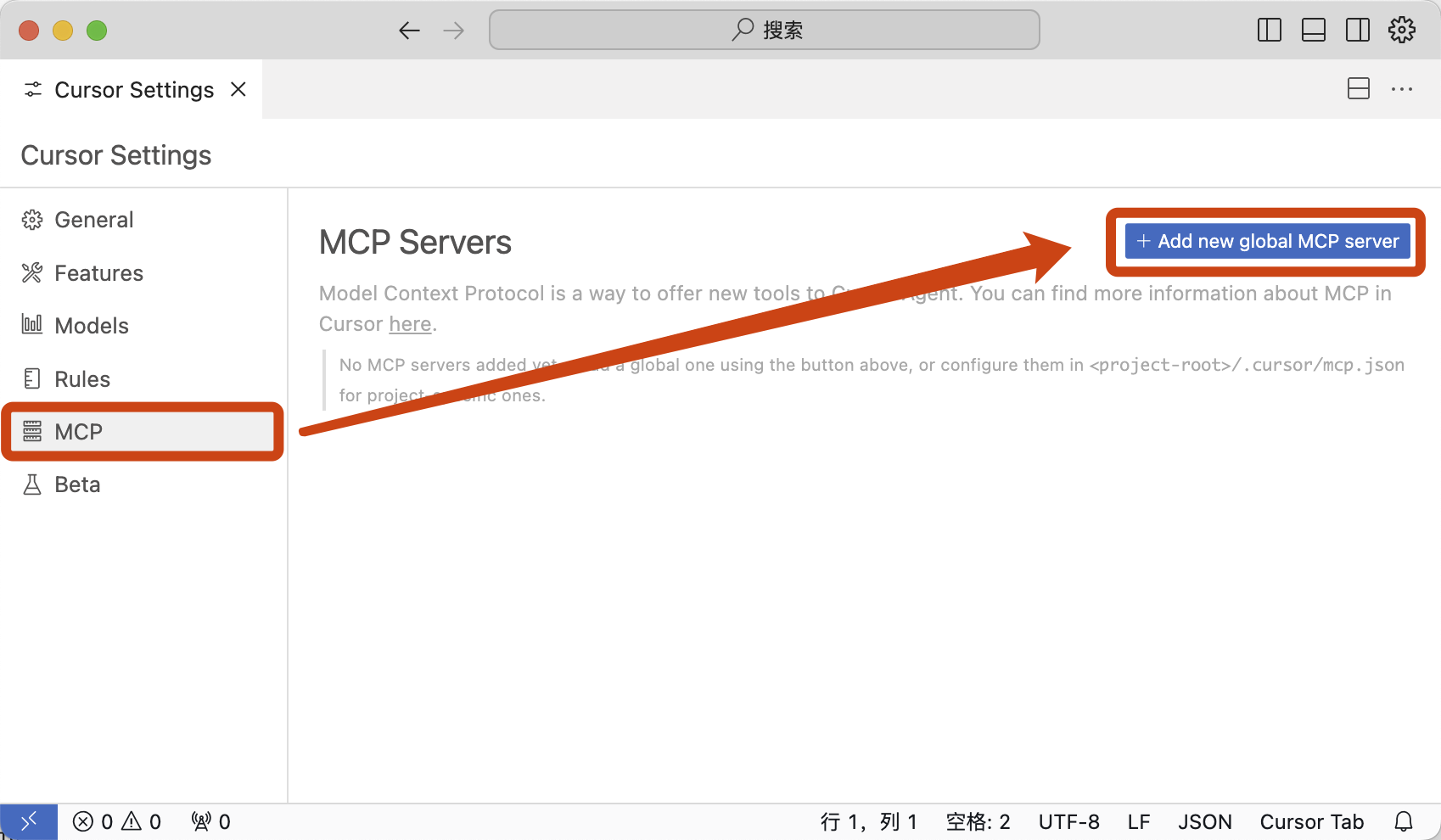

Cursor の場合、Cursor Settings を開き、図の手順に従って操作し、以下の設定を入力する必要があります。

{"mcpServers": {"firerpa": {"url": "http://192.168.0.2:65000/firerpa/mcp/"}}}

注目

MCP 拡張機能の作成¶

ヒント