การเชื่อมต่อโมเดล (MCP/Agent)¶

บทความนี้จะแนะนำวิธีการเชื่อมต่อ FIRERPA กับโมเดลภาษาขนาดใหญ่ (LLM) (ผ่าน MCP หรือคำสั่ง) FIRERPA ได้ติดตั้งโปรโตคอลฝั่งเซิร์ฟเวอร์ของ MCP และฟังก์ชัน tool-call ดั้งเดิมของ OpenAI ไว้ในระดับ low-level แล้ว ซึ่งรองรับการเขียนปลั๊กอิน MCP ของคุณเองและให้บริการผ่านพอร์ตมาตรฐาน 65000 หรือสืบทอดคลาส Agent เพื่อเรียกใช้ tools แบบอัตโนมัติเต็มรูปแบบ

คำสั่ง Agent ในตัว¶

คุณสามารถใช้คำสั่ง agent ในตัวเพื่อทำงานที่ใช้ภาษาพูดทั่วไปให้สำเร็จได้อย่างรวดเร็วผ่านโมเดลภาษาขนาดใหญ่ รองรับผู้ให้บริการใดๆ ที่เข้ากันได้กับ OpenAI API + toolcall หรือบริการที่คุณสร้างขึ้นเอง เมื่อใช้ร่วมกับ crontab ในตัว คุณสามารถตั้งเวลาให้งานที่ใช้ภาษาพูดทำงานตามกำหนดเวลาได้

คำแนะนำ

ข้อควรสนใจ

หลังจากเตรียมข้อมูลที่จำเป็นเรียบร้อยแล้ว คุณสามารถป้อนคำสั่งต่อไปนี้ในเทอร์มินัลของรีโมทเดสก์ท็อปเพื่อให้ AI ควบคุมอุปกรณ์ของคุณโดยอัตโนมัติ

agent --api https://generativelanguage.googleapis.com/v1beta/openai/chat/completions --key YOUR_API_KEY --model gemini-2.5-flash --prompt "ช่วยฉันเปิดแอปตั้งค่า แพ็กเกจชื่อ com.android.settings ค้นหาการตั้งค่าเครือข่าย และเปิดโหมดเครื่องบิน"

หาก prompt สำหรับงานของคุณยาวเกินไป คุณสามารถระบุ prompt ของโมเดลผ่านไฟล์ได้เช่นกัน

agent --api https://generativelanguage.googleapis.com/v1beta/openai/chat/completions --key YOUR_API_KEY --model gemini-2.5-flash --prompt /path/to/prompt.txt

การเชื่อมต่อ Claude & Cursor (MCP)¶

ส่วนนี้จะแนะนำวิธีการเชื่อมต่อฟังก์ชัน MCP ของ FIRERPA เข้ากับไคลเอนต์โมเดลภาษาขนาดใหญ่ของคุณ เราได้ยกตัวอย่างเฉพาะ Claude และ Cursor เท่านั้น คุณยังสามารถใช้งานได้ในที่อื่นๆ ที่รองรับโปรโตคอล MCP

หมายเหตุ

ข้อควรสนใจ

การติดตั้งส่วนขยายอย่างเป็นทางการ¶

เราได้จัดเตรียมบริการ MCP อย่างเป็นทางการไว้ให้คุณ ซึ่งคุณสามารถดาวน์โหลดส่วนขยายนี้ได้ที่ extensions/firerpa.py คุณยังสามารถอ้างอิงวิธีการเขียนเพื่อสร้างหรือขยายฟังก์ชันปลั๊กอินด้วยตนเองได้ หลังจากดาวน์โหลดสคริปต์ปลั๊กอินส่วนขยายแล้ว ให้อัปโหลดไปยังไดเรกทอรี /data/usr/modules/extension ของอุปกรณ์ผ่านรีโมทเดสก์ท็อปหรือใช้คำสั่ง push ด้วยตนเอง จากนั้นรีสตาร์ทอุปกรณ์หรือบริการ FIRERPA

ข้อควรสนใจ

การใช้งานส่วนขยายอย่างเป็นทางการ¶

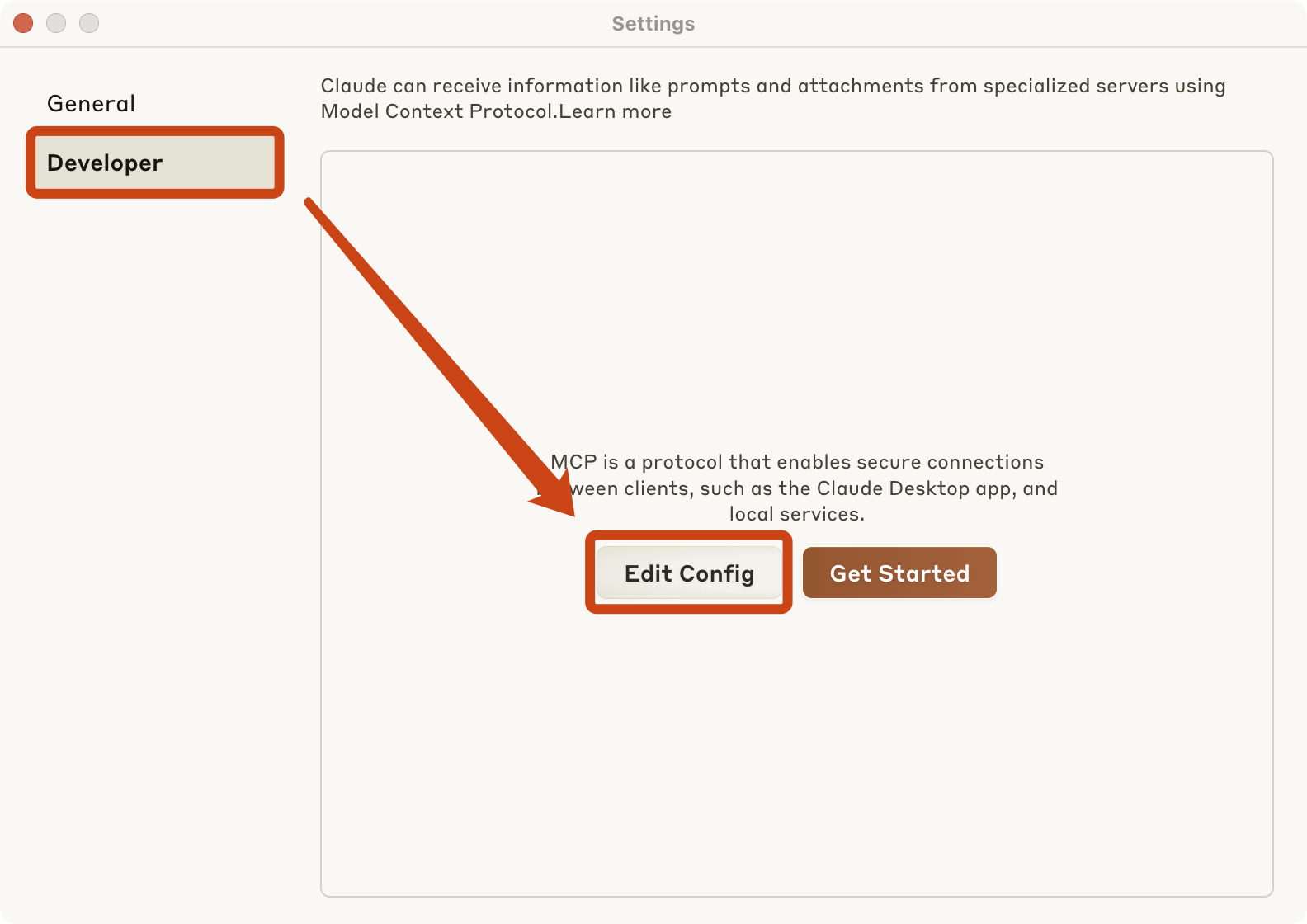

สำหรับ Claude คุณต้องไปที่หน้าการตั้งค่าของ Claude และดำเนินการตามขั้นตอนที่แสดงในภาพด้านล่าง จากนั้นแก้ไขไฟล์กำหนดค่า claude_desktop_config.json ของ Claude ตามคำแนะนำ และเพิ่มการกำหนดค่าบริการ MCP json ต่อไปนี้

{"mcpServers": {"firerpa": {"command": "npx", "args": ["-y", "supergateway", "--streamableHttp", "http://192.168.0.2:65000/firerpa/mcp/"]}}}

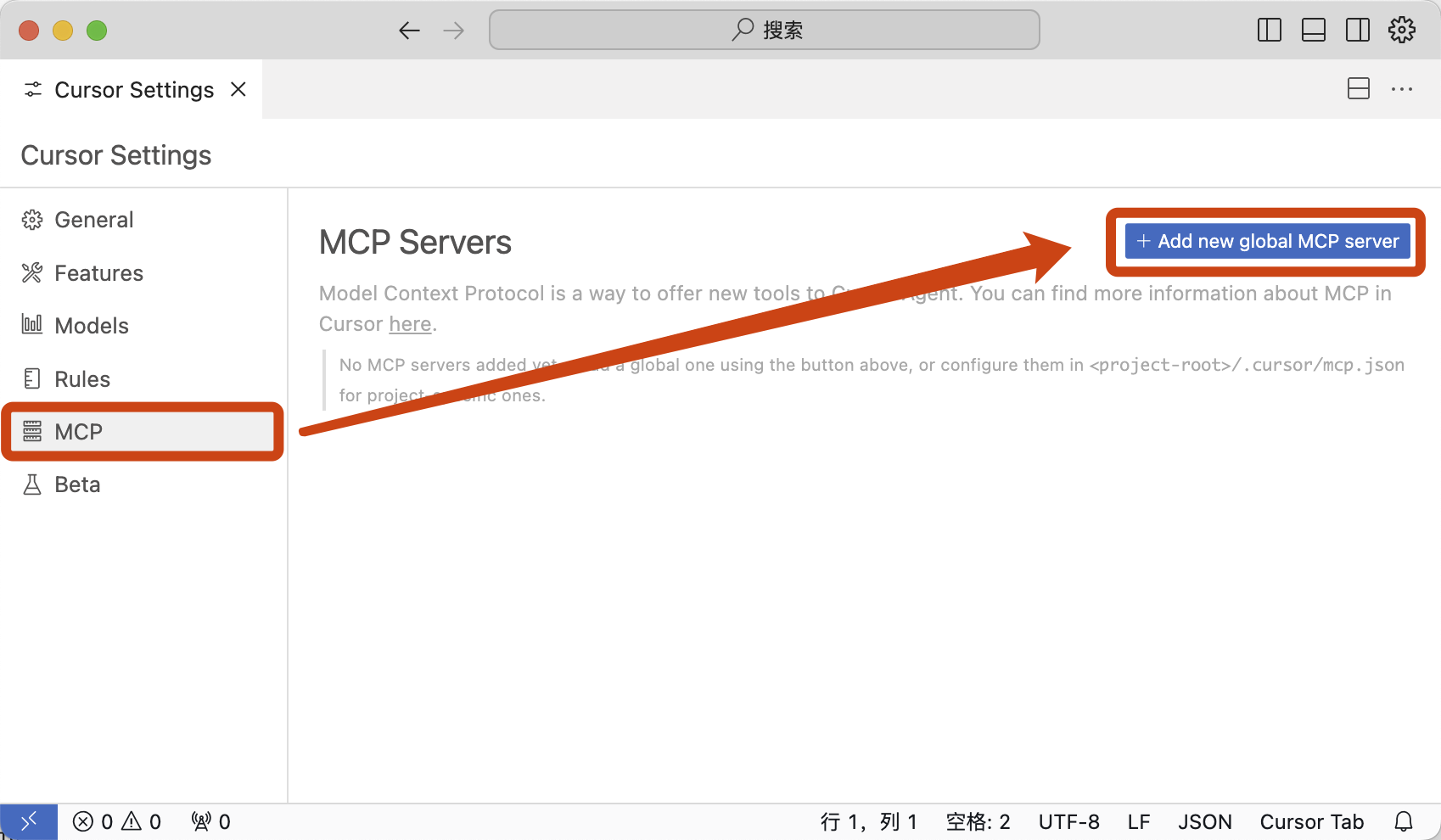

สำหรับ Cursor คุณต้องเปิด Cursor Settings ดำเนินการตามที่แสดงในภาพ และป้อนการกำหนดค่าต่อไปนี้

{"mcpServers": {"firerpa": {"url": "http://192.168.0.2:65000/firerpa/mcp/"}}}

ข้อควรสนใจ

การเขียนส่วนขยาย MCP¶

คำแนะนำ